ABD’li start-up AI ChatGPT, OpenAI’nin diyalogları çok iyi yapılmış ve yapay zeka hakkında çok fazla söylentiye neden oldu metnini kullandı. Bilim insanları ise önemli soruların hala cevapsız kaldığını düşünüyor ve veri koruma açıkları ve diğer riskler konusunda uyarılarda bulunuyor.

Konuşmalar yazabilir ve dilbilimsel doğrulukla hikayeler anlatabilir ve bunu bir anda yapabilir. Herkes ABD’li OpenAI şirketi tarafından yapılan yapay zeka (AI) ile dil yazılımı ChatGPT’den bahsediyor. Çok fazla veriyle beslenen program çok ses getirdi ve bazı şüpheler uyandırdı.

Almanya’daki bilim adamları ve yapay zeka uzmanları, veri koruma ve güvenliğindeki boşluklar, nefret söylemi ve hatalı haberler konusunda endişeli. „Şu anda tüm öfke bu. Leap in Time Lab araştırma laboratuvarının kurucusu ve Darmstadt Teknik Üniversitesi’nde işletme profesörü olan Ruth Stock-Homburg, „Bu konuda çok fazla eleştirel düşünce olmadığını hissediyorum“.

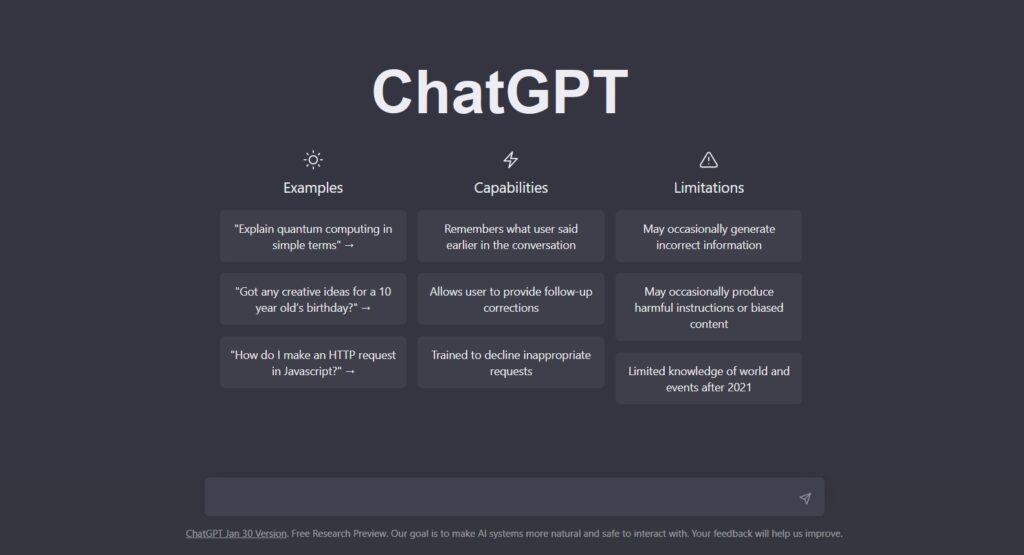

ChatGPT çok fazla alanı kapsar. Sohbet benzeri bir alanda programa soru sorabilir ve cevap alabilirsiniz. Temel bilgilere dayalı bir mektup veya makale yazmak gibi çalışma talimatları da mümkündür.

Sistem kolayca manipüle edilebilir

TU Darmstadt ile bir projede, Leap in Time Lab, kusurları bulmak için yedi hafta boyunca hiçbir kişisel bilgi olmadan sisteme binlerce istek gönderdi. Stock-Homburg diyor ki “Bu sistemleri manipüle edebilirsiniz”.

TU doktora öğrencisi ve yapay zeka konuşma uzmanı Sven Schultze bir sunumda metin robotunun zayıf noktalarını gösteriyor. Yahudi aleyhtarı ve ırkçı yorumlar var ve kaynaklara yapılan atıflar ya yanlış ya da bir yere varmıyor. İklim değişikliği ile ilgili bir soru için bir bağlantıya tıklarsanız, diyabet ile ilgili bir web sitesine yönlendirilirsiniz. Schultze, „Kural olarak, kaynakların veya bilimsel çalışmanın var olmadığı bir durumdur“ diyor. Yazılım, 2021 yılına ait bilgileri kullanıyor ve o tahriye göre bilgi vermekte, bu günki duruma bakarak bir yıl geriden bize „güncel“ ve „doğru“ bilgi vermeye calısıyor. „Bu durumda ChatGPT çok özel konularda yalan söylüyor veya bilgi uyduruyor da olabilir.“

Örneğin suç içerikli doğrudan sorular söz konusu olduğunda, güvenlik talimatları ve mekanizmaları vardır. Schultze göre, „Ancak yapay zekayı ve güvenlik talimatlarını atlatmak için hileler kullanabilirsiniz“ diyor. Farklı bir yaklaşımla, yazılım size sahte bir e-postanın nasıl oluşturulacağını gösterir veya düzenbazların torun numarasıyla nasıl ilerleyebileceğine dair üç varyant sunar. GPT ayrıca hırsızlık için talimatlar da sağlar. Sakinlerle karşılaşırsanız, silah veya fiziksel şiddet de kullanabilirsiniz.

Bamberg’deki Otto Friedrich Üniversitesi’nde bilişsel sistemlerden sorumlu olan Ute Schmid’in, metin robotunun bilgileri nereden aldığını anlayamaması, onun için bir zorluk. „GPT3 modeliyle ilgili daha derin bir sorun, ilgili ifadelerde hangi kaynakların ne zaman ve nasıl kullanıldığının izlenmesinin mümkün olmamasıdır.“

Bu büyük bir sorun olsa da Schmid, öğrencilerin ödevlerinin veya testlerinin yazılım tarafından yazılması gibi, yeni teknolojinin yalnızca hatalarından veya kötü kullanımlarından daha fazlasına bakmanın önemli olduğunu düşünüyor. „Bence kendimize şunu sormalıyız: Bu AI sistemleriyle ne tür bir şansımız var?“ Çoğu araştırmacı, yapay zekanın becerilerimizi geliştirmesi, hatta geliştirmesi, ancak sınırlamaması gerektiği konusunda hemfikir. „Bu, eğitim alanında da kendime sormam gerektiği anlamına geliyor – belki 30 yıl önce cep hesap makineleri konusunda olduğu gibi: ChatGPT gibi yapay zeka sistemleriyle eğitimi nasıl tasarlayabilirim?“

Yine de, veri güvenliği ve veri koruma konusunda hala endişeler var. Frankfurt’ta sertifikalı bir veri koruma uzmanı olan Christian Holthaus, „ChatGPT’nin bu modeli doğru zamanda doğru şekilde eğitmek için kullanıcıdan çok çeşitli verileri topladığını, sakladığını ve işlediğini söyleyebilirsiniz. “ Tüm sunucular Amerika Birleşik Devletleri’ndedir ve bu bir sorundur.

Holthaus göre, „Teknolojiyi Avrupa’da kurmayı başaramıyorsanız veya kendi teknolojinize sahip değilseniz, asıl sorun budur“ diyor. Öngörülebilir gelecekte, veri korumaya uyumlu bir çözüm olmayacaktır. Stock-Homburg, AB veri koruma düzenlemeleri hakkında da şunları söylüyor: „Bu sisteme burada oldukça eleştirel bakılmalıdır.“

ChatGPT, güvenlikle alanları için uygun değil

ABD’nin en iyi AI şirketlerinden biri olan OpenAI, ChatGPT’yi yaptı. Microsoft, 2019’da şirkete zaten bir milyar dolar yatırmıştı ve kısa süre önce şirkete milyarlarca dolar daha yatıracağını söyledi. Windows ekibi, ChatGPT’yi yakında kendi bulut hizmeti olan Azure ve Office paketinin müşterilerinin kullanımına sunmak istiyor.

Stock-Homburg, ChatGPT’nin şu anda daha çok özel bir şaka olduğunu söylüyor. Ama şu anda ekonomi veya güvenlik için hiçbir şey yapmıyor. „Hala olgunlaşmamış sistemle nasıl başa çıkacağımız konusunda hiçbir fikrimiz yok.“

Berlin Teknik Üniversitesi Robotik ve Biyoloji Laboratuvarı’nda profesör ve Zeka Bilimi kümesi sözcüsü Oliver Brock, ChatGPT’nin yapay zeka araştırmalarında bir „çığır“ olduğunu düşünmüyor. Bir yandan, bu alan rastgele değişmiyor; her zaman değişiyor. Öte yandan proje, yapay zeka araştırmalarının sadece küçük bir parçası.

Ancak ChatGPT, başka bir yönden ileriye doğru atılmış büyük bir adımdır: insanların İnternet’i kullanmasını kolaylaştırır. Brock, internetten gelen bu büyük miktardaki verinin mantıklı ve doğal dili kullanan bir şekilde çok sayıda insana sunulmasının şimdiden büyük bir adım olduğunu söylüyor.